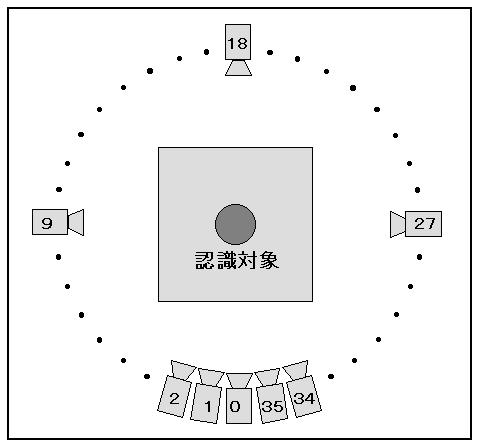

ここでは、提案手法の検証を行うために単純な画像列として、人工的に 作成したCG画像を使用してシミュレーション実験を行った。視点は対象 となるオブジェクトの横方向に正面からの角度を0度から360度まで10度 刻み変化させ計36個配置した。また、それぞれの視点位置には0から35ま での番号を付加した。この様子をオブジェクトの上方から見たものを図 4.1に示す。

図4.1:視点の位置(シミュレーション実験)

認識の対象となる動作は2種類用意した。それぞれの視点位置において、 この2つの動作について学習し、その視点位置での視点評価値を算出した のち、各視点位置において、入力された動作がどちらの動作であるのか を認識する認識実験を行ない視点評価値を検証した。

使用するデータは、160x120のサイズの画像で、作成したCG画像をそのま ま標準パターンとして登録した。ジェスチャ学習時には、標準パターン 登録時に使用した画像に対し、全画素数の1%のランダムノイズを付加し たものを使用した。

認識の際に使用するデータは、ジェスチャ学習時の使用したものと同様、 標準パターン登録時に使用した画像に対し、全画素数の1%のランダムノ イズを付加したものを使用した。このデータを各動作それぞれ50画像、 計100画像用意し認識率を求めた。

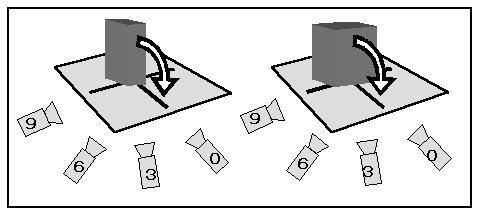

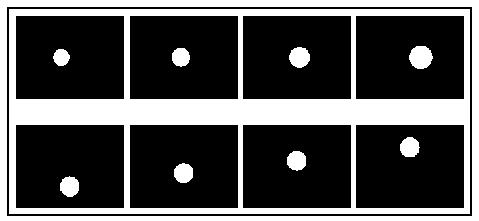

以上の条件で実験を行なう際に、2組の動作を用意し実験を行なった。ま ず、1組目の実験では、認識の対象となる動作は2種類で、1つ目の動作は 配置された各視点の中心に、各視点で撮影される画像において上下方向 に長い直方体を置き、時間経過とともに直方体の最下部を中心として視 点位置0の方向に90度転倒するというものである。2つ目の動作は、1つ目 の動作で使用したオブジェクトを、転倒する方向に対して垂直な方向に2 倍に拡大したものを使用し同様の動作を行った。それぞれの動作の様子 を図4.2に示す。

図4.2:認識対象動作(シミュレーション実験:オブジェクト変化)

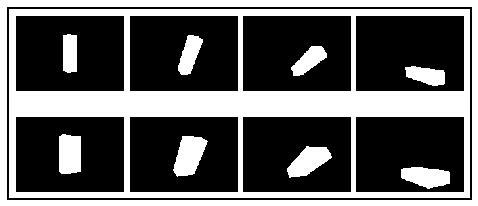

この実験では、同じオブジェクトで、動作そのものが変化したときの視 点評価値を検証した。 それぞれの動作の例を図4.3に示す。

図4.3:動作の例(シミュレーション実験:オブジェクト変化)

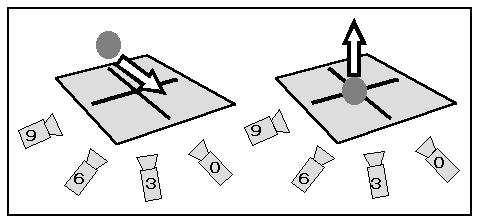

2組目の実験では、認識の対象となる動作は1組目の実験同様2種類で、球 が視点が配置される平面に対して平行に、視点位置18から視点位置0の方 向へ移動する動作と、球が視点が配置される平面に対して垂直に、各視 点で撮影される画像内で下部から上方へ移動する動作とした。それぞれ の動作の様子を図4.4に示す。

図4.4:認識対象動作(シミュレーション実験:動作変化)

この実験では、異なるオブジェクトが同じ動作をした場合の視点評価値 を検証した。 それぞれの動作の例を図4.5に示す。

図4.5:動作の例(シミュレーション実験:動作変化)

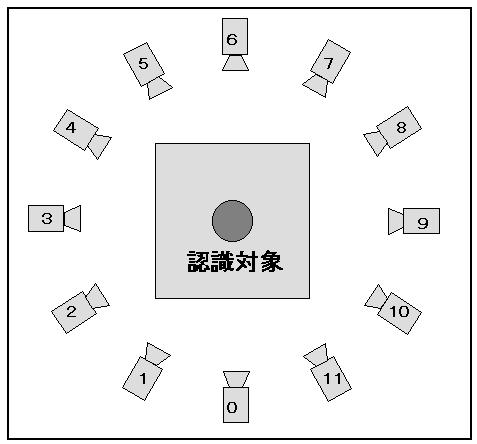

この実験では、実際にビデオカメラから入力した画像を用いて実験を行 い、本手法の検証を行った。視点は対象となるオブジェクトの横方向に 正面からの角度を0度から360度まで30度刻みで変化させ計12個配置し、 それぞれの視点位置には0から11までの番号を付加した。この様子をオブ ジェクトの上方から見たものを図4.6に示す。

図4.6:視点の位置(実画像実験1)

シミュレーション実験時と同様に、認識の対象となる動作は2種類用意し た。それぞれの視点位置において、この2つの動作について学習し、その 視点位置の視点評価値を算出し、各視点位置において入力された動作が どちらの動作であるのかを認識する認識実験を行った。

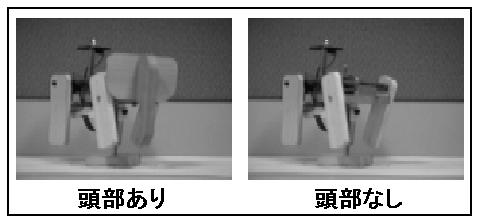

使用する画像データは、サイズが160x120であり、1つ目の動作は、象の 模型(TAMIYA製 Walking Elephant Set:ITEM 70094)を視点位置0の方向に 向け配置し4本の足を前後に振り、それに合わせて頭を左右に動かすもの とし、2つ目の動作は、象の模型のうち頭部を外したものを同様に配置し 4本の足を前後に振るものとした。なお、撮影には、CCD-G100GT(SONY製) を使用した。それぞれの動作に使用した模型を図4.7に、また、動作の例 を図4.8に示す。

図4.7:使用した模型(実画像実験1)

図4.8:動作の例(実画像実験1:視点位置1)

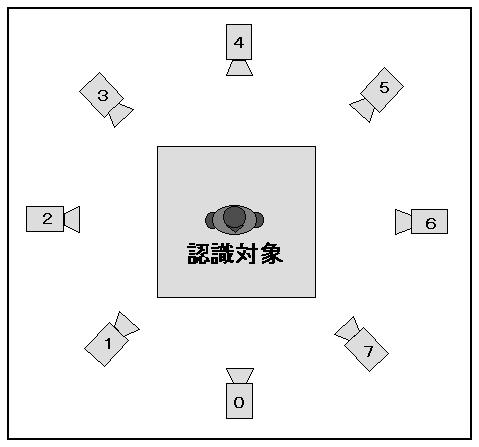

この実験においても、実画像実験1と同様、実際ににビデオカメラから撮 影した画像を入力とした。視点は対象となるオブジェクトの横方向に正 面からの角度を0度から360度まで45度刻みで変化させ計8個配置した。ま た、それぞれの視点位置には0から7までの番号を付加した。この様子を オブジェクトの上方から見たものを図4.9に示す。

図4.9:視点の位置(実画像実験2)

この実験では、認識の対象となる動作は4種類用意した。それぞれの視点 位置において、この4つの動作について学習し、その視点位置での視点評 価値を算出し、各視点位置において、入力された動作がどちらの動作で あるのかを認識する認識実験を行ない視点評価値を検証する。

使用する画像データは、サイズを160x120とした。認識対象の動作は人間 が行う動作であり、従来手法での固定した視点から撮影した場合に認識 が困難になるであろう無意識的な動作を含む以下の4種類の動作を用意し た。

| 頭を掻く | 人物が椅子に座って両手を膝の上においてある状態から右手で頭 を掻く動作 |

| 腕を組む | 物が椅子に座って両手を膝の上においてある状態から両手で腕を 組む動作 |

| 手を挙げる | 人物が椅子に座って両手を膝の上においてある状態から右手を上 に挙げる動作 |

| 口をおさえる | 人物が椅子に座って両手を膝の上においてある状態から右手で口 をおさえる動作 |

なお、撮影にはDCR-VX1000(SONY製)を使用した。それぞれの動作の例を 図4.10に示す。

図4.10:動作の例(実画像実験2:視点位置1)