|

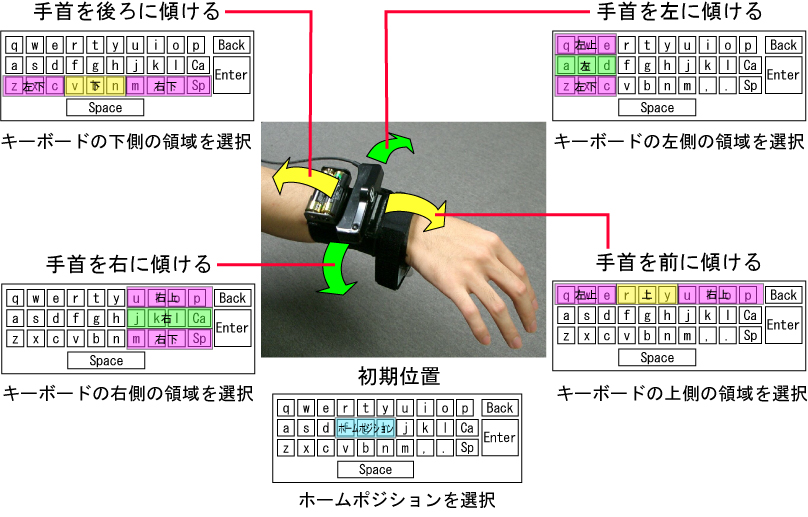

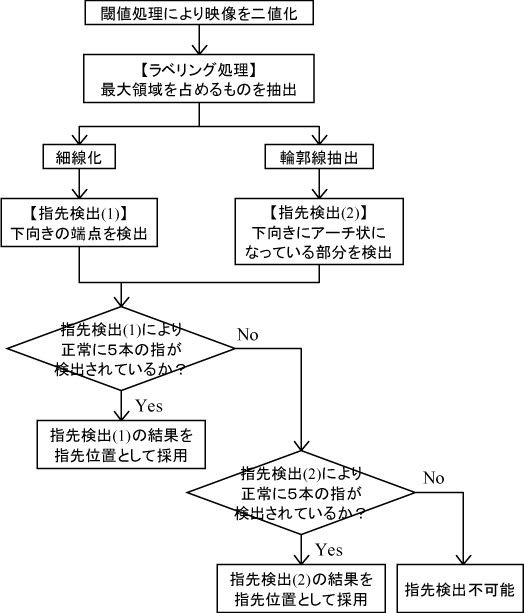

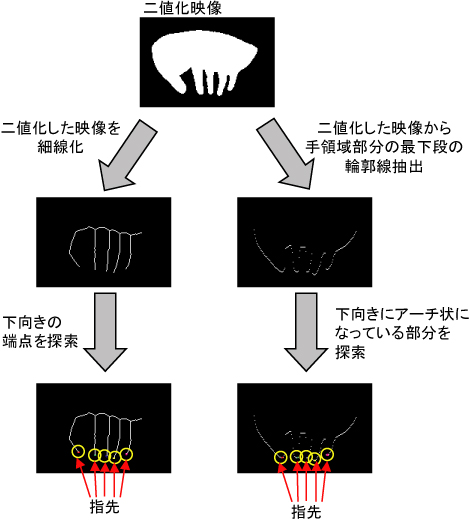

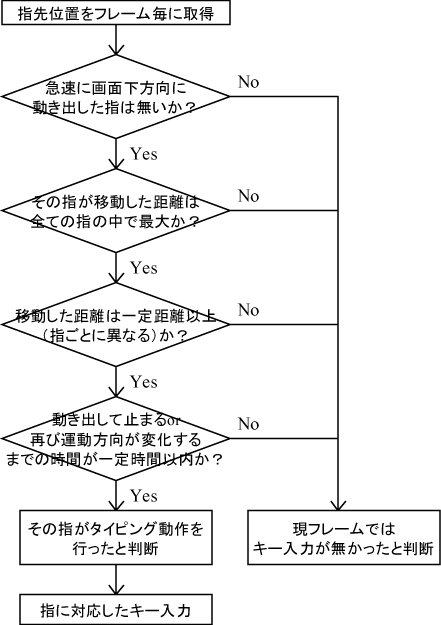

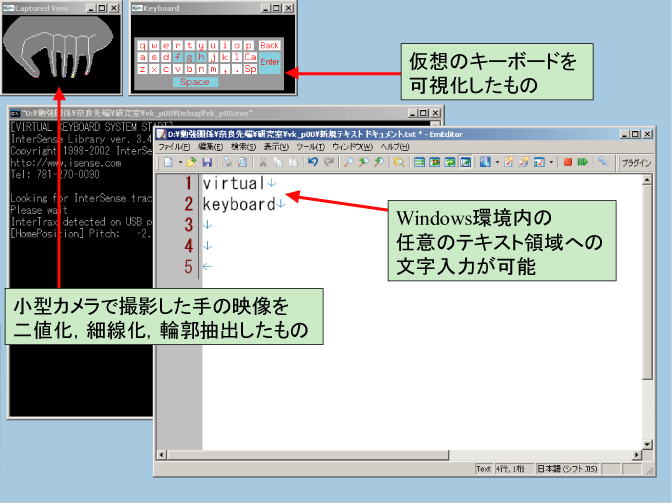

文字入力インタフェースをウェアラブルに適応するためには,装着機器による身体の拘束度合いを可能な限り削減し,文字入力以外の他の作業への移行が容易になるよう考慮する必要がある. 物理的なキーボードを用いずに,タイピング動作による文字入力を実現する ためには,どの入力キーが選択され,タイピングされたか,をシステムが正確に認識しなければならない. そこでこの認識を,以下の二つの判別処理に分けて考える. i. どのキーがタイピング可能な状態か ii. タイピングがなされたか まず,上記i.について考える. キーボードに配列されているキー上のどこに手が存在しているかによって,その時にタイピング可能なキーの候補は変化する. したがって,上記i.を認識することは,現実の手の動きを仮想キーボード上の手の位置変化へと対応付けることと言える. 次に,上記ii.の判断は,指先の動作をセンシングすることにより行われるが, 身体を可能な限り拘束せずに指先の動作をセンシング出来ることが望ましい.

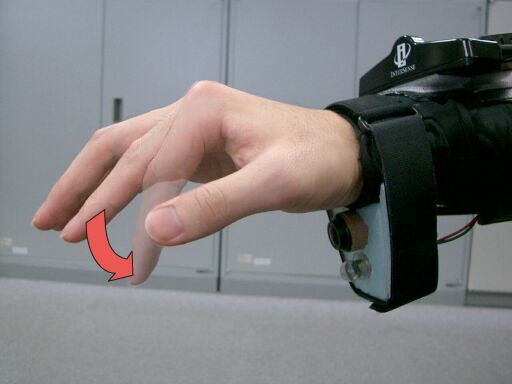

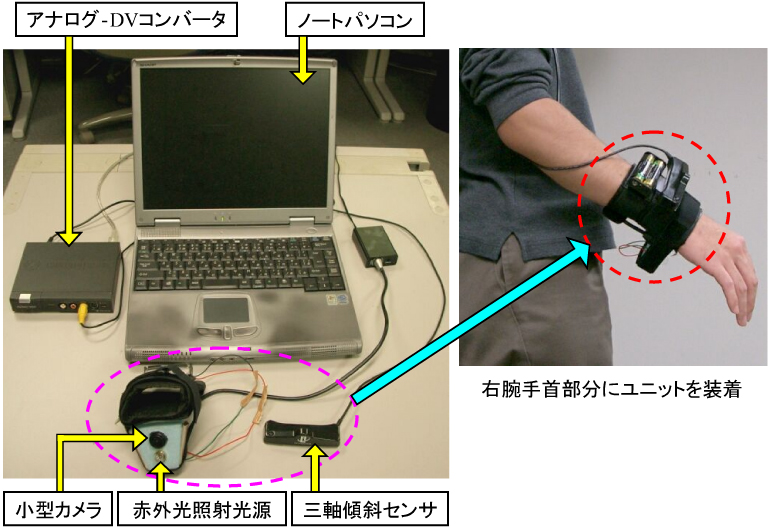

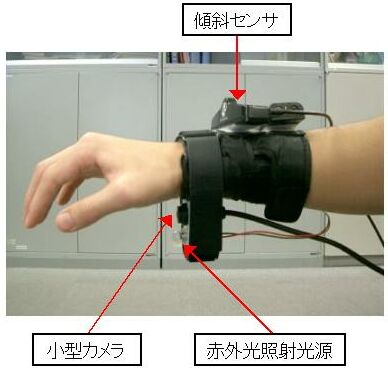

本研究で提案する手法では,i.とii.の判別処理に必要となるセンサ機器を最小構成にするために,手首に小型カメラと傾斜センサを装着して用いる. 傾斜センサの出力に応じて手と仮想キーボードとの位置関係を対応付け,カメラで撮影した指先の映像から,時々刻々の指先の動作を捉える. この構成により,中空をタイピングする手と指の動作でキー入力が可能になる. また,装着機器が手首だけでまとまるため,手と指は自由になると同時に,キー入力をしない時に指先を使った他の動作(物を掴む,メモを取る,等)に移行しやすくなる. |